Der EU-AI-Act

KI im Unterricht – neue Regeln, klare Richtlinien. Von Barbara Mack

Hausaufgaben, bei denen plötzlich niemand mehr weiß, ob sie von den Schüler*innen oder von Chat GPT stammen. Unterrichtsprojekte, bei denen KI-Bildgeneratoren mitbasteln. Und Referate haben ausgedient, weil sie in wenigen Minuten auf Knopfdruck erstellt werden können – inklusive Quellenangaben und Präsentation.

Viele Lehrkräfte sind verunsichert, wenn es um den Einsatz von KI geht. Was ist erlaubt und sinnvoll, wo fehlen noch Erfahrungen? Was verändert sich für den Unterricht, was für Prüfungen? Die technischen Entwicklungen sind rasant. Die rechtlichen und pädagogischen Grundlagen hinken allerdings deutlich hinterher.

Der neue EU-AI-Act bringt hier eine wichtige Wende. Er schafft erstmals einen verbindlichen Rahmen für den Einsatz von KI in der Bildung, dessen Ziel es ist, KI-Systeme so zu gestalten und zu verwenden, dass sie nachvollziehbar bleiben, den Menschen in den Mittelpunkt rücken und dem Lernen wirklich nützen.

Besonders wichtig: Der Gesetzgeber verpflichtet ausdrücklich dazu, Fortbildungen und Informationen bereitzustellen. Lehrkräfte sollen mit dieser Entwicklung nicht allein gelassen werden – und das ist keine Option, sondern Teil des Gesetzes.

Aber worum geht es in diesem neuen Gesetz mit dem komplizierten Namen nun eigentlich genau? Der EU-AI- Act klingt erst einmal nach einem juristischen Fachtext, der mit unserem Schulalltag wenig zu tun hat. Schauen wir also einmal genauer hin: Was regelt er wirklich – und was bedeutet das für uns als Lehrkräfte?

Der EU-AI-Act: Weichenstellung für die Zukunft der KI

Der EU-AI-Act ist das erste umfassende Gesetz weltweit, das den Einsatz von Künstlicher Intelligenz (KI) regelt. Er wurde 2024 vom Europäischen Parlament und dem Rat der EU verabschiedet. Die ersten Bestimmungen traten bereits 2025 in Kraft, weitere folgen in mehreren Schritten.

Das Gesetz legt fest, dass KI-Systeme mit den europäischen Grundwerten im Einklang sein müssen. Dazu gehören vor allem die Grundprinzipien Menschenwürde, Demokratie, Transparenz und Datenschutz.

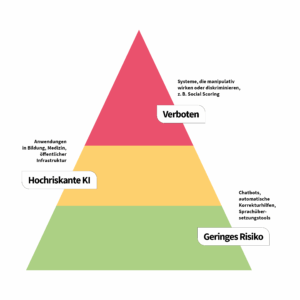

Neu ist dabei der risikobasierte Ansatz: Der AI-Act arbeitet nicht mit generellen Verboten oder Freigaben, sondern unterscheidet nach dem potenziellen Risiko für den Menschen und für die Gesellschaft. Je höher dieses Risiko eingeschätzt wird, desto strenger sind die Vorgaben.

Die KI-Risikopyramide – und warum Schule nicht im grünen Bereich liegt

Der EU-AI-Act stuft KI-Systeme in verschiedene Risikobereiche ein. Die Bewertung richtet sich danach, wie stark ein System Grundrechte berühren oder gesellschaftliche Prozesse beeinflussen kann. Die Anforderungen an Sicherheit, Transparenz und Kontrolle steigen mit dem potenziellen Risiko, das ein KI-System in sich birgt.

Im roten Bereich sind KI-Systeme angesiedelt, die Menschen manipulieren oder diskriminieren können, z. B. das sogenannte Social Scoring (Systeme, die Menschen mit KI anhand ihres Verhaltens oder bestimmter persönlicher Merkmale bewerten, mit Folgen für ihre Rechte und Chancen, z. B. bei der Kreditvergabe oder bei Bewerbungen um einen Arbeitsplatz) oder biometrische Massenüberwachung. Solche Anwendungen sind verboten.

Als „Hochrisikobereich“ (gelb) gelten Anwendungen, die in besonders sensiblen gesellschaftlichen Bereichen eingesetzt werden, zum Beispiel in der Medizin, bei Sicherheitsbehörden oder im Bildungswesen. Auch der schulische Kontext fällt in diesen Bereich. KI darf hier eingesetzt werden – aber nur unter klar definierten Bedingungen: mit hoher Transparenz, Nachvollziehbarkeit und nach entsprechenden Fortbildungen.

Chatbots (Programme, die automatisiert auf Texteingaben reagieren und antworten, z. B. Chat GPT), automatische Korrekturhilfen oder Übersetzungsprogramme gelten als unproblematisch. Sie dürfen grundsätzlich verwendet werden, müssen aber in manchen Fällen klar gekennzeichnet werden – zum Beispiel dann, wenn ein Chatbot direkt mit Schüler*innen kommuniziert. Hier sind wir im grünen Bereich

Was der EU-AI-Act für den (Religions-) Unterricht bedeutet

Mit dem neuen Rechtsrahmen wird klargestellt: Schulen dürfen KI-Tools (Programme mit KI, die z. B. Texte, Bilder oder Musik erzeugen, Inhalte analysieren oder zusammenfassen, etc.) weiterhin nutzen – aber nicht unreflektiert. Lehrkräfte und Schulleitungen stehen nun vor der Aufgabe, neue Regeln zu beachten, Verantwortung zu übernehmen und die Qualität von Lernprozessen auch und gerade unter Einsatz von KI zu sichern. Damit rücken rechtliche, technische und pädagogische Fragen gleichermaßen in den Fokus.

Für Schulen bedeutet das konkret:

- Der Einsatz von KI bleibt möglich, ist aber an klare Bedingungen geknüpft.

- Anbieter müssen offenlegen, wie ihre Systeme funktionieren, welche Daten sie verarbeiten und wie Entscheidungen zustande kommen.

- Schulen sind verpflichtet zu prüfen, ob die eingesetzten Anwendungen rechtlich zulässig und pädagogisch verantwortbar sind – ähnlich wie wir das bereits vom Datenschutz oder Urheberrecht kennen.

Gerade der Religionsunterricht kann hier einen wichtigen Beitrag leisten:

- Er stärkt die ethische Urteilsfähigkeit und eröffnet Räume für verantwortungsvolle Auseinandersetzung mit Fragen nach Freiheit, Verantwortung und Gewissen – auch im digitalen Raum.

- Er thematisiert das christliche Menschenbild: Jeder Mensch ist einmalig, unverfügbar und besitzt eine unantastbare Würde. Das widerspricht jeder technischen Reduktion auf Daten und Kategorien.

- Er eröffnet Perspektiven auf die Beziehung zwischen Mensch, Technik und Weltanschauung, etwa dort, wo KI-Systeme „entscheiden“ oder Menschen

- Er fördert digitale Mündigkeit: Schüler*innen sollen befähigt werden, KI-Anwendungen kritisch einzuordnen und selbstbestimmt zu nutzen.

Deshalb ist die Auseinandersetzung mit KI nicht nur Sache der MINT-Fächer – sie gehört auch und gerade in den Religionsunterricht.

Denn dieser fragt nicht nur nach der Funktion von Technologie, sondern nach dem Menschen – nicht nur als Nutzer, sondern als Geschöpf mit Würde, Freiheit und Verantwortung. Im Zentrum unseres Unterrichts steht das christliche Menschenbild. Es betont Personalität, Sozialität und Transzendentalität, also die Einzigartigkeit des Menschen, seine Beziehungsfähigkeit und seine Offenheit für das Göttliche. Gerade im Umgang mit KI werden diese Grunddimensionen auf neue Weise herausgefordert:

Wenn Maschinen Entscheidungen treffen, Texte generieren oder Menschen bewerten, stellen sich zentrale ethische Fragen nach Verantwortung, Menschenwürde und der Rolle, die Technologie in unserem Leben spielen soll. Wir Religionslehrkräfte haben die Chance, diesen Diskurs aktiv mitzugestalten und unsere Schülerinnen und Schüler dabei zu begleiten, sich mit einem reflektierten, wertebasierten Blick in der digitalen Welt zu orientieren.

Fortbildung ist Pflicht und Chance

„Anwender von Hochrisiko-KI-Systemen haben sicherzustellen, dass die natürlichen Personen, die für den Einsatz dieser Systeme zuständig sind, über das notwendige Wissen und die entsprechende Schulung verfügen.“ (Artikel 29 EU-AI-Act)

Diese Vorgabe betrifft auch Schulen – insbesondere dann, wenn KI-Systeme zur Lernstandsanalyse, zur Bewertung oder zur automatisierten Rückmeldung eingesetzt werden. Solche Anwendungen dürfen nur genutzt werden, wenn die verantwortlichen Lehrkräfte entsprechend geschult sind.

Im Gesetzestext gibt es dabei derzeit keine konkreten inhaltlichen Vorgaben für diese Schulungen. Aus den offiziellen Erläuterungen ergeben sich jedoch vier zentrale Aspekte, die Fortbildungen in diesem Bereich berücksichtigen sollen:

- Rechtliche Vorgaben

- Technische Funktionsweise

- Ethische Einordnung

- KI-Kompetenz („AI-Literacy“, ein Verständnis dafür, wie KI im Unterricht sinnvoll und reflektiert eingesetzt wird)

Gerade diese KI-Kompetenz macht den Unterschied: Lehrkräfte brauchen nicht nur theoretische Kenntnisse, sondern auch praktische, anwendungsbezogene Fähigkeiten, etwa bei der Auswahl oder Interpretation von KI-Tools.

Fortbildungen sind damit nicht nur eine flankierende Maßnahme, sondern zentraler Bestandteil eines verantwortungsvollen KI-Einsatzes in der Schule. Damit soll sichergestellt werden, dass Lehrkräfte in der unübersichtlichen und komplexen KI-Landschaft nicht alleine gelassen werden.

Schulen, Träger und Fortbildungseinrichtungen sind hier gefordert. Sie müssen:

-

-

-

- Fortbildungsangebote bereitstellen, die rechtssicher und praxisnah sind.

- Lehrkräfte sowohl technisch als auch ethisch sowie im Falle des Religionsunterrichts mit zusätzlicher Reflexion aus theologischer und religionspädagogischer Sicht, begleiten.

- klare Kriterien entwickeln, wann ein KI-Einsatz pä-agogisch vertretbar ist.

- KI-Kompetenz systematisch fördern, z. B. durch praxisnahe Module zu Tool-Auswahl, Unterrichtsbeispielen und Reflexion.

-

-

In der Diözese Würzburg ist dieser Prozess bereits angestoßen. Die Abteilung „Schule und Hochschule“ bietet schon seit 2023 regelmäßige Fortbildungsangebote zu allen geforderten Aspekten an. Diese Angebote werden stetig ausgebaut und auch im kommenden Jahr fortgeführt.

Der Einsatz von KI stellt uns im Unterrichtsalltag vor ganz neue Herausforderungen. Umso wichtiger ist es, dass Lehrkräfte Sicherheit gewinnen, fundierte Entscheidungen treffen können und dabei in der Fortbildung verlässliche Partner*innen finden.

KI – ja bitte: aber mit Haltung statt Hype!

Der EU-AI-Act ist kein Bremsklotz, sondern ein Geländer. Er hilft, den Einsatz von Künstlicher Intelligenz pädagogisch zu verantworten, juristisch zu sichern und ethisch zu durchdenken. Nicht alles, was möglich ist, ist auch sinnvoll – aber vieles, was sinnvoll ist, wird durch klare Regeln erst wirklich verantwortbar.

Gerade der Religionsunterricht kann hier Brücken bauen: zwischen Technologie und Ethik, zwischen Innovation und Verantwortung, zwischen Gesellschaft und Gewissen.

KI verändert Schule. Aber mit dem EU-AI-Act bekommen wir endlich Werkzeuge, um diese Veränderung bewusst zu gestalten – nicht aus Angst, sondern aus christlicher Verantwortung für Menschlichkeit, Bildung und eine gute Zukunft mit KI.

Hinweis in eigener Sache:

Dieser Artikel ist im engen Zusammenspiel mit ChatGPT entstanden – nicht als automatisch generierter Text, sondern als bewusst geführter Dialog. Ich habe zentrale inhaltliche Linien gesetzt, den Text mehrfach überarbeitet und meine fachliche Perspektive eingebracht. ChatGPT war für mich dabei eine kreative Partnerin beim Brainstorming, bei der Reflexion und der sprachlichen Feinarbeit. Der fertige Text ist das Ergebnis eines menschlich-künstlichen Kooperationsprozesses – ein Beispiel dafür, was entstehen kann, wenn man mit KI gemeinsam denkt – und manchmal auch mit ihr ringt. 😉